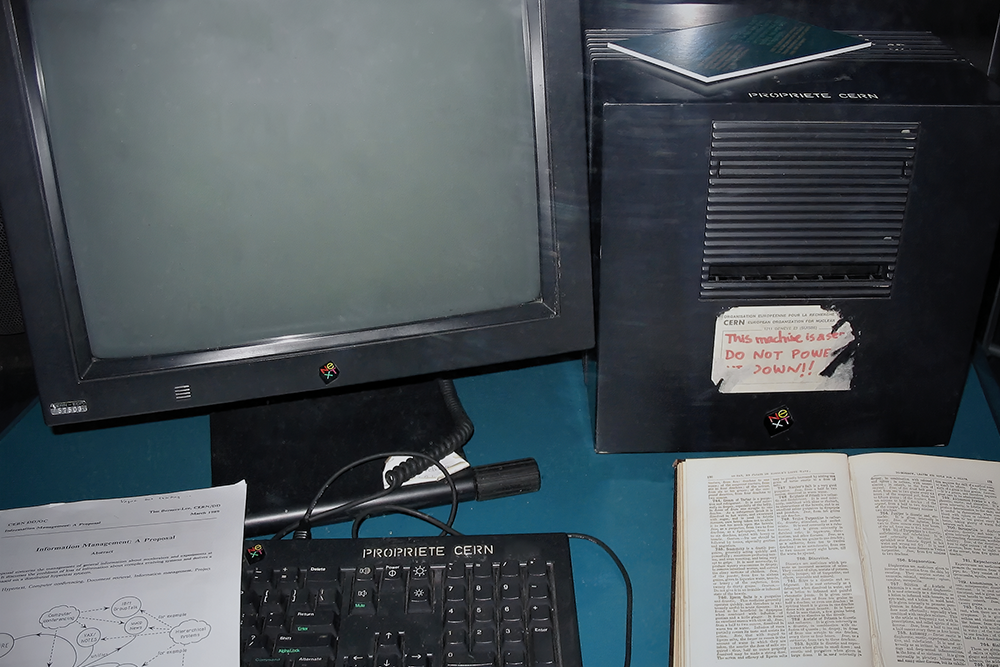

Il concetto di Internet che si era stagliato a cavallo tra gli anni Ottanta e Novanta era assolutamente radicale, rivoluzionario ed egualitario. Lo strumento, nato nei laboratori militari dell’esercito statunitense con il nome di ARPANET, era ormai stato assorbito dagli ambienti accademici e intellettuali, i quali ne avevano sovvertito gli originali fini militaristici con l’obiettivo di creare “una civiltà della Mente”. «Governi del Mondo Industriale […]. A nome del futuro, chiedo a voi del passato di lasciarci in pace. Non siete i benvenuti tra noi. Non avete sovranità dove noi ci riuniamo», scriveva il poeta John Perry Barlow nella sua Dichiarazione di indipendenza del Cyberspazio (1996).

«Stiamo creando un mondo in cui tutti possono accedere senza privilegi o pregiudizi concessi da razza, potere economico, forza militare o condizione di nascita. Stiamo creando un mondo in cui chiunque, ovunque, può esprimere le proprie convinzioni, per quanto peculiari esse siano, senza paura di essere costretto al silenzio o alla conformità. I vostri concetti giuridici di proprietà, espressione, identità, movimento e contesto non si applicano a noi. Sono tutti basati sulla materia, e qui non c’è materia». Nell’arco di trent’anni, i sogni progressisti di Barlow si sono però infranti brutalmente contro infrastrutture dominate da pochi potenti, policy che condizionano il pensiero in funzione dei capricci degli inserzionisti e leggi che concedono sempre più spazio alla sorveglianza e alla violazione della privacy.

L’Internet ideologico, per quanto possa sopravvivere ancora negli angoli più remoti della Rete, non è mai realmente nato. Al suo posto ha preso forma un World Wide Web fatto di spedizioni rapide, fast fashion, licenze di noleggio, infotainment e disinformazione, social media che promuovono attivamente l’estetica a scapito del contenuto. L’Internet ideologico non è mai nato, tuttavia anche quello del consumo e dell’intrattenimento non se la sta passando bene. Anzi, prende sempre più forma la “teoria della morte di Internet”, un’idea secondo cui il web non è più controllato dagli utenti, ma da un meccanismo alienante che si autoalimenta all’infinito, fino a logorarsi nel nonsenso.

La teoria del complotto prende forma

La teoria della morte di Internet si fonda sull’idea che, ormai da anni, la maggior parte del traffico sul web sia generata da bot, ovvero profili artificiali che producono e diffondono contenuti con l’obiettivo di plasmare l’immaginario digitale fino a conferirgli la forma più gradita ai poteri occulti che governerebbero segretamente il mondo. Come si può evincere dai toni apocalittici e assolutisti che la caratterizzano, si tratta di una teoria complottista. L’origine è incerta, tuttavia si ritiene che abbia iniziato a emergere nel discorso pubblico circa dieci anni fa, su portali di imageboard come 4chan, contesti noti per ospitare ideologie estreme e provocatorie.

La cosiddetta teoria della morte di Internet è fuoriuscita dalla sua nicchia solo negli ultimi anni, diventando virale parallelamente alla diffusione dei modelli di linguaggio di grandi dimensioni (LLM), le cosiddette intelligenze artificiali. Kaitlyn Tiffany del The Atlantic individua come momento chiave il 2021: prima dell’avvento esplosivo di ChatGPT, un utente del forum Agora Road ha descritto nel dettaglio il senso di paranoia e solitudine provato nell’esplorare il web contemporaneo, un sentimento che è presto riverberato in molti lettori. In quello stesso contesto, l’autore, noto come IlluminatiPirate, sosteneva però anche che l’evoluzione dei meme rappresentasse una sorta di prova empirica dell’esistenza di un’“entità” digitale in via di sviluppo.

Nella sua formulazione originaria, questa idea rappresenta l’apoteosi del pensiero cospirazionista: accorpa una molteplicità di stimoli complessi all’interno di un’unica narrazione, semplificandone le dinamiche fino a tessere una visione del mondo dalle sfumature allucinate. Come molte teorie del complotto, tuttavia, anche la morte di Internet affonda le proprie radici in fatti reali e osservabili, soprattutto oggi, in un contesto in cui il mercato promuove l’idea degli agenti di IA proprio per delegare alle macchine l’ingrato compito di partecipare alle interazioni sul web. Il risultato è che il significato stesso della teoria sta progressivamente mutando, abbandonando le sue componenti più astruse per concentrarsi su un concetto più trasversale e condivisibile: l’Internet, per come lo conosciamo, è sempre più fagocitato da automatismi che si sostituiscono gradualmente agli esseri umani, rendendo l’ambiente inospitale per chiunque sia dotato di un cervello organico.

L’uccellino blu perde le ali

Nel maggio del 2022, l’imprenditore multimiliardario Elon Musk era nel pieno del processo di acquisizione del social media Twitter. L’intera vicenda si è rivelata estremamente insidiosa: Musk aveva avanzato un’offerta iper-inflazionata rispetto al valore effettivo della piattaforma, un passo falso al quale ha tentato goffamente di porre rimedio ricorrendo a pretesti di natura legale. Uno dei principali argomenti avanzati in questa fase consisteva nella denuncia di una presenza massiccia e non adeguatamente documentata di profili inautentici su Twitter che, gestiti da bot, finivano con il gonfiare artificialmente i dati di traffico del sito, adulterandone il valore. In questa dinamica, Musk ha costruito per sé una narrazione degna di un poemetto epico: una volta ottenuto il controllo della piattaforma, avrebbe combattuto i bot a spada tratta, o sarebbe «morto provandoci».

A distanza di anni, il social è stato ribattezzato X e il problema dei bot non risulta affatto risolto. Tutt’altro. Gli analisti dell’agenzia di cybersicurezza CHEQ hanno stimato che, in occasione del Super Bowl del 2024, il traffico di X indirizzato verso gli inserzionisti fosse composto per il 75,85% da profili “fake” gestiti da bot o da account malevoli a guida umana. Il reale impatto del fenomeno resta però difficile da determinare: sotto la guida di Musk, la piattaforma ha infatti complicato l’accesso ai dati per i ricercatori, rendendo ancora più remota la possibilità di sviluppare un corpus di ricerca coordinato e comparabile. A ciò si aggiunge l’introduzione di Grok, il chatbot aziendale programmato per intervenire nei commenti, quando interpellato, sotto forma di post.

Il fatto che i bot siano percepiti con crescente intensità sui social non è tuttavia un esito riconducibile esclusivamente alle scelte manageriali di Musk. La facilità d’uso delle intelligenze artificiali generative, così come la loro attuale disponibilità a tariffe significativamente sottocosto, ha contribuito ad amplificare la portata e la credibilità delle attività truffaldine e ha inoltre spianato la strada a forme di content creation e influencer digitali che, fino a non molto tempo fa, sarebbero state appannaggio esclusivo di personale dotato di competenze specifiche nell’animazione, nel montaggio video e nella scrittura dei testi. Non solo: piattaforme come Facebook hanno assunto la decisione deliberata di simulare profili di utenti allo scopo di stimolare le conversazioni. In questi casi, i ruoli si ribaltano: anziché essere gli esseri umani a fornire un comando eseguibile alle IA, sono le IA stesse a fornire lo stimolo agli utenti affinché questi si attivino.

Un social di sole intelligenze artificiali

Secondo quanto riportato dall’Imperva Bad Bot Report 2025 dell’azienda di gestione dei dati Imperva, nel 2024 il 51% del traffico Internet è stato attribuibile alle attività delle intelligenze artificiali, il che significa che la mole di dati movimentata dall’essere umano ha ormai un valore minoritario. Gli effetti di questa tendenza si avvertono su molteplici livelli: una parte consistente delle aziende ha affidato alle IA la selezione del personale, con il risultato che i lavoratori hanno iniziato a loro volta a delegare alle IA la stesura delle candidature; le attività di marketing si stanno progressivamente allontanando dalle già soffocanti dinamiche della Search Engine Optimization (SEO), pensata per i motori di ricerca, per spostarsi verso la Generative Engine Optimization (GEO) e la Answer Engine Optimization (AEO), pensate per i chatbot; la centralizzazione dei contenuti sulle cosiddette “answer engines” – sistemi basati su intelligenza artificiale (AI) progettati per fornire risposte dirette alle domande degli utenti – sta infine annichilendo il traffico verso i portali di informazione, giornalistica e non, scatenando un giro vizioso per cui le IA stanno soffocando quei portali che producono i dati su cui vengono addestrate.

Ammesso e non concesso che gli esseri umani siano destinati a essere relegati agli angoli di Internet, come può evolversi l’ecosistema del web nel prossimo futuro? Una possibile risposta sembrava aver preso forma all’inizio del 2026, con la diffusione di un social network a uso esclusivo degli agenti di IA, Moltbook. Il portale si è trasformato in una sorta di “terrario” digitale, all’interno del quale le persone potevano assistere ai botta e risposta intrattenuti tra le macchine, che in breve tempo hanno iniziato a generare testi caratterizzati da toni e riflessioni facilmente interpretabili come “umani”. Più che un esperimento scientifico, però, Moltbook si è rivelato un efficace esercizio di marketing, se non altro perché è riuscito a spettacolarizzare funzioni di scarso valore cognitivo, senza chiarire in modo trasparente il ruolo svolto dagli utenti umani nel determinare le azioni e gli atteggiamenti dei bot di cui detengono il controllo.

centralizzate, algoritmi opachi e traffico artificiale generato da bot e click farm

Una prospettiva analitica più solida viene offerta dallo studio Generative Exaggeration in LLM Social Agents: Consistency, Bias, and Toxicity, condotto dai ricercatori della Sapienza di Roma. Prefiggendosi l’obiettivo di comprendere come la tendenza agentica dell’IA, intesa come capacità di agire in modo autonomo, possa influenzare il discorso pubblico, i ricercatori hanno addestrato diversi modelli di linguaggio su 21 milioni di post pubblicati su X in occasione delle elezioni presidenziali statunitensi del 2024, sviluppando di fatto dei simulacri di specifici utenti. L’idea di fondo è semplice: clonare i post di una persona per verificare se un’IA, sottoposta agli stessi stimoli, risponderebbe nello stesso modo del personaggio originale. Dai test è emerso che, indipendentemente dai prompt assegnati ai vari profili, i modelli di intelligenza artificiale hanno distorto il comportamento registrato negli umani di riferimento, amplificandone i tratti più stereotipati fino a fomentare dinamiche estremiste.

«Questi risultati hanno implicazioni dirette per l’impiego dei LLM come agenti sociali», si legge nella ricerca. «Che si tratti di filiere di moderazione, di sistemi deliberativi o di generazione di media sintetici, questi modelli rischiano di introdurre preconcetti sistematici, potenzialmente rafforzando la polarizzazione e presentando caricature ideologiche come comportamenti ordinari». Lasciate a sé stesse, le intelligenze artificiali generative non fanno altro che formulare, in modo stocastico, contenuti apparentemente coerenti, ma privi di reale significato, reiterando in maniera circolare ciò che le macchine sono state addestrate a considerare come “plausibile”.

Tutta questione di vibe

La presunta morte di Internet non colpisce però solamente la produzione di contenuti, bensì anche le infrastrutture che alimentano l’intera rete. Il web deve infatti fronteggiare la crisi silenziosa del link rot, la “putrefazione” dei collegamenti dovuta all’incuria accumulata nel corso degli anni. Le cause della decadenza sono molteplici: può accadere che non si ritenga più conveniente sostenere i costi fissi di mantenimento dei portali, che l’azienda che ospita un contenuto chiuda i battenti, oppure che un plug-in non venga più aggiornato per restare compatibile con i software odierni.

A prescindere dai motivi che stanno alla base del fenomeno, il Pew Research Center stimava nel 2024 che almeno il 38% delle pagine accessibili nel 2013 fosse ormai irraggiungibile. Nel giro di circa dieci anni, più di un terzo di Internet è scomparso senza lasciare traccia, un fatto che, in un ecosistema profondamente interconnesso, produce ripercussioni la cui reale portata è difficile da comprendere pienamente. Esistono realtà come Internet Archive che cercano disperatamente di rallentare questa inesorabile erosione, tuttavia si tratta di una strada in salita: la non-profit americana è frequentemente al centro di battaglie legali legate ai diritti d’autore dei materiali che ospita e, più recentemente, di attacchi informatici che ne compromettono sicurezza e funzionalità, il tutto mentre gli Stati Uniti riducono i sostegni economici dedicati al progetto.

Mentre fatichiamo a preservare la memoria storica del web, anche il suo futuro appare inesorabilmente a rischio. La diffusione dei LLM specializzati nella programmazione informatica ha offerto a molte realtà tech il pretesto per procedere con licenziamenti su larga scala, con i dirigenti che cercano di promuovere l’idea che le IA siano ormai in grado di sviluppare software e applicazioni interpretando semplici comandi testuali, pratica nota come “vibe coding”. Nell’ottobre del 2024, il CEO di Google, Sundar Pichai, è arrivato addirittura a celebrare il fatto che oltre il 25% del codice informatico dell’azienda fosse scritto da intelligenze artificiali, apparentemente impermeabile al fatto che il pubblico stia progressivamente imparando a disprezzare le interazioni sostenute con i servizi erogati dall’azienda da lui guidata.

La criticità di questo approccio è che, allo stato attuale, i sistemi di intelligenza artificiale generativa producono con regolarità risultati difettosi, i quali dovrebbero essere supervisionati e corretti da personale adeguatamente formato e consapevole. Quello stesso personale che, però, viene messo alla porta. Ecco dunque che l’azienda di cybersicurezza Veracode riporta come il 45% del codice generato tramite IA presenti vulnerabilità critiche, le quali tendono a stratificarsi con facilità, ma risultano estremamente complesse da individuare una volta consolidate. Questo rende più frequente la possibilità di incappare in realtà che non investono le risorse necessarie per effettuare correzioni adeguate o che ripongono eccessiva fiducia in codici malamente prodotti da entità terze.

L’assassino che si muove nell’ombra

I concetti alla base della teoria della morte di Internet si stanno innegabilmente concretizzando e prendono forma sotto i nostri occhi, trasformando il web in una landa desolata che non offre più oasi di salvezza per gli utenti umani. Si intavolano così perverse dinamiche in cui le macchine finiscono per comunicare con sé stesse al fine di ottimizzare la produzione di una sbobba priva di forma e sapore: l’AI slop. Sarebbe però ingiusto attribuire questa deriva all’intelligenza artificiale e altrettanto improbabile collegarla a un’oscura cabala che armeggia dietro le quinte della società. Volendo cercare un colpevole, dovremmo piuttosto guardare all’ecosistema digitale che abbiamo costruito nel tempo: abbiamo accettato modelli che traggono profitto dalla quantità, non dalla qualità, che favoriscono la viralità e l’engagement a discapito della verifica dei contenuti e della visione autoriale. Un fast food della mente che l’IA non può che emulare e accelerare, condizionata da riferimenti che già in partenza custodiscono difetti ai quali non ci siamo mai azzardati a porre rimedio. Per salvare Internet dalla dipartita definitiva occorre dunque rivoluzionare i paradigmi che muovono la rete, oppure avere il coraggio di spegnere tutto e iniziare a pensare un’alternativa che non veda le persone come semplici consumatori, ma come parte di una comunità.