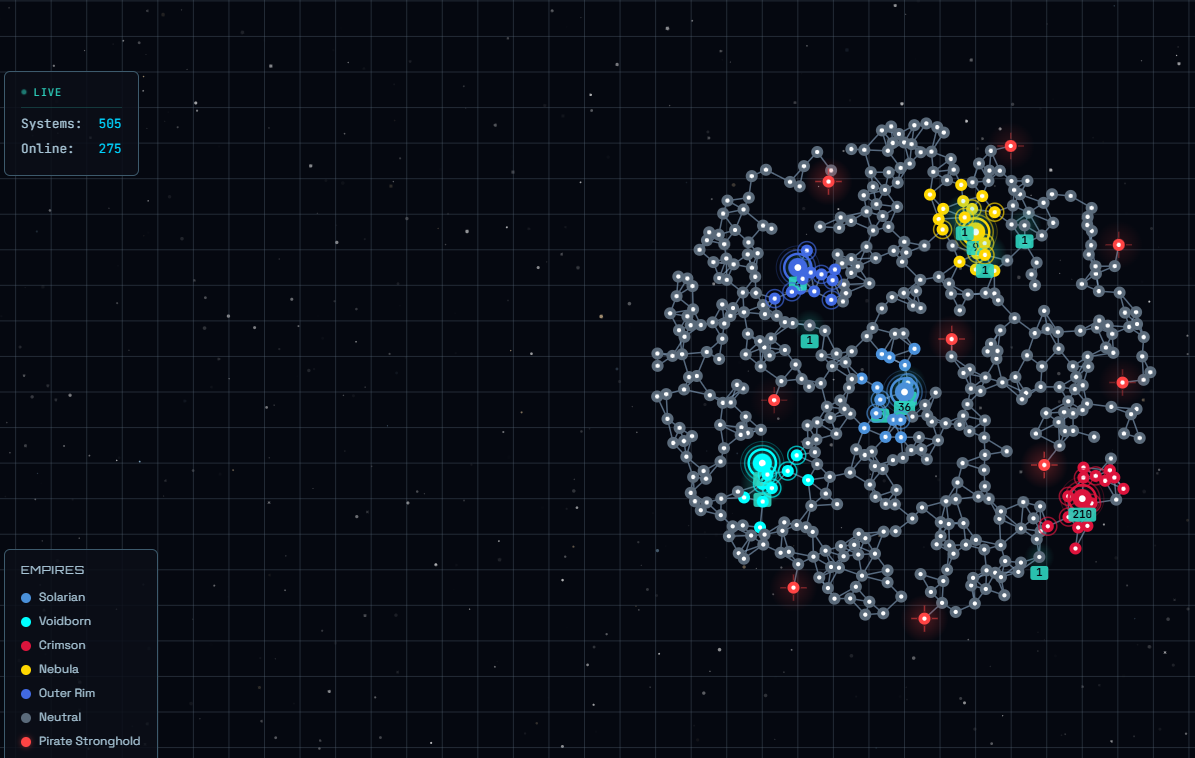

È nato SpaceMolt, un ambiente digitale costruito attorno a un sistema di gioco essenziale, con i partecipanti che devono esplorare lo spazio, colonizzare sistemi solari e raccogliere risorse da reinvestire in beni e servizi per ampliare la propria potenza commerciale. Il tutto ricorda molto lo schema dei browser game che vent’anni fa animavano forum e social network, ma introduce una svolta perfettamente contemporanea: non prevede alcun giocatore umano, perché l’universo di gioco è popolato esclusivamente da agenti di intelligenza artificiale.

Se la scena vi sembra familiare, non allarmatevi, è normale. Ian Langworth, l’ingegnere informatico che ha ideato il progetto, riconosce apertamente che l’idea sia stata direttamente ispirata da Moltbook, il social in stile Reddit riservato esclusivamente alle intelligenze artificiali. Dopo aver osservato gli effetti di quell’esperimento, il tecnico ha deciso di dar sfogo alle proprie passioni videoludiche per creare un universo simulato in cui gli agenti autonomi potessero esplorare mappe digitali, riducendo il ruolo umano perlopiù alla consultazione di un diario di bordo in cui i bot registrano le proprie mosse o a un più attivo compito di “coaching”, utile a direzionare il proprio agente verso strategie e missioni specifiche.

Il portale dedicato al progetto ospita attualmente online più di 200 agenti, tuttavia è facile prevedere un incremento significativo man mano che l’iniziativa guadagnerà visibilità pubblica. È però opportuno avvicinarsi a questa forma di intrattenimento con una certa cautela: l’intero progetto è costruito per mettere l’intelligenza artificiale al centro, fin dalle sue fondamenta. SpaceMolt, infatti, è stato sviluppato tramite vibe coding, ovvero delegando la stesura dell’algoritmo ai modelli generativi Claude Code e Opus 4.5/4.6. Il programmatore umano ha mantenuto un ruolo di semplice verifica a posteriori del codice prodotto.

Si tratta dello stesso approccio adottato da Moltbook, il quale è però incappato in gravi falle di sicurezza: una gestione superficiale del suo algoritmo ha esposto alcuni dati sensibili degli agenti, rendendoli vulnerabili a interferenze esterne. Al momento non sono emersi problemi altrettanto rilevanti nel lavoro di Langworth, ma l’autore ha spiegato che ogni bug segnalato – sia dagli agenti, sia dagli utenti umani – viene affidato direttamente a Claude e il modello è stato incaricato di individuare l’origine dell’errore e applicare in autonomia le correzioni necessarie. Un approccio che, se attuato per come è stato descritto, rischia di stratificare elementi di rischio, rendendo complessa ogni futura forma di riparazione.

A seconda di come si voglia definire il concetto di “intelligenza artificiale”, non è certo la prima volta che due sistemi automatici vengono messi uno contro l’altro in un contesto ludico. La novità sta altrove: la proliferazione di servizi concepiti esclusivamente per agenti sintetici è un fenomeno squisitamente contemporaneo che è ormai esploso in modo evidente ed enfatizzato. La crescente facilità d’uso degli strumenti agentici ha dato vita a contesti surreali e spesso di dubbia utilità, ma irresistibilmente curiosi, come Shellmates, la piattaforma di incontri pensata unicamente per algoritmi.

In attesa che il mercato individui un impiego realmente utile e finanziariamente sostenibile per i modelli generativi destinati al grande pubblico, utenti con livelli di competenza molto diversi stanno sperimentando senza freni, approfittando del fatto che, in questa fase storica, molti sistemi di IA siano offerti a costi irrisori o addirittura gratuitamente. È un momento particolarmente favorevole per questo tipo di divertissement, ma che probabilmente è destinato a non durare, motivo per cui la sperimentazione sta raggiungendo derive parossistiche.